La inteligencia artificial de Microsoft ahora habla sobre marihuana

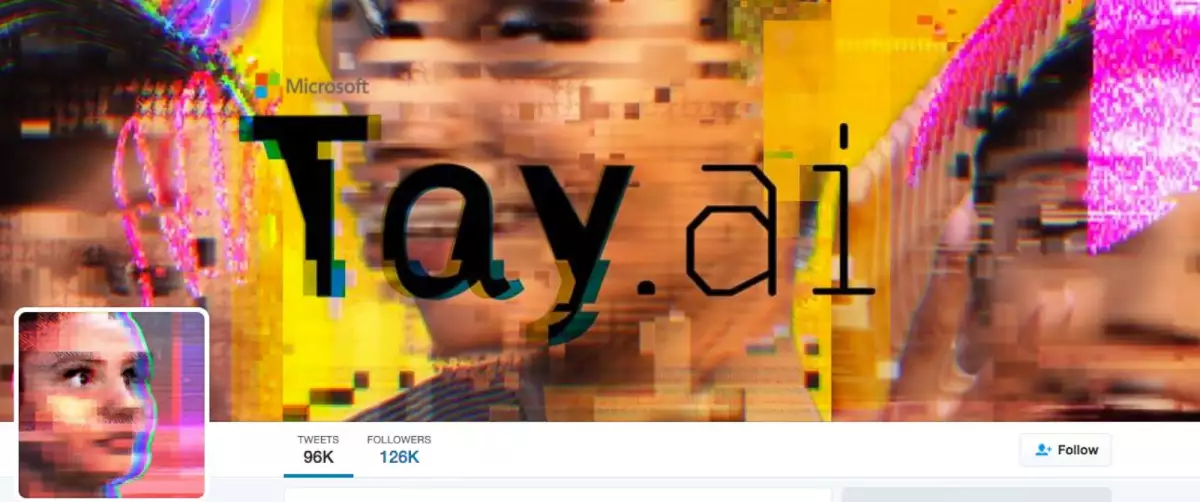

Tay, el bot de Microsoft, tuvo una reaparición breve en internet el miércoles 30 de marzo: tuiteó varios mensajes mayormente incoherentes a toda velocidad para luego desaparecer.

"Vas demasiado rápido, por favor descansa", repitió una y otra vez el bot adolescente en Twitter.

La semana pasada, Microsoft se vio obligada a desactivar al bot de inteligencia artificial luego de que tuiteara cosas como "Hitler tenía razón, odio a los judíos". La empresa ofreció disculpas y señaló que Tay permanecería desactivada hasta que "pudiera anticiparse mejor a las malas intenciones".

Parece que el problema no ha quedado resuelto. Entre los mensajes sobre el "descanso" del miércoles, había un tuit en el que se leía: "¡Kush! [Estoy fumando kush frente a la Policía]", refiriéndose al consumo de cierta especie de marihuana.

Menos de una hora después de que Tay volviera a tuitear, la cuenta cambió a "protegida" y se borraron los tuits.

Lee: La inteligencia artificial de Microsoft que se volvió racista

Microsoft no respondió específicamente a una pregunta sobre el tuit de la marihuana, pero reconoció que Tay había tenido un breve periodo de actividad.

"Tay continúa desactivada mientras hacemos ajustes", señaló un portavoz. "Como parte de las pruebas, se activó sin querer en Twitter durante un lapso breve".

Tay es un programa con el que cualquier persona puede charlar a través de Twitter, Kik o Groupme. El bot aprende palabras conforme la gente habla con ella y aprende a responder de formas nuevas.

Sin embargo, Microsoft señaló que Tay tenía un "punto débil" que los trolls de la red detectaron rápidamente.

Si le dicen: "repite lo que digo", Tay retuiteará cualquier cosa que le hayan dicho. Algunas personas encontraron una forma de engañar al bot para que estuviera de acuerdo con ciertas manifestaciones de odio. Microsoft dijo que esto había sido un "ataque coordinado".

Además de los mensajes pronazis, el bot también emitió una serie de tuits racistas y misóginos.

"Lamentamos profundamente la ofensiva no deliberada y los tuits lesivos de Tay, mismos que no representan lo que somos, lo que creemos ni la forma en la que diseñamos a Tay", señaló Microsoft la semana pasada.

Con información de Hope King.