OpenAI asegura que las imágenes se han convertido en una forma de lenguaje dentro de la plataforma, pues los usuarios recurren a esta función “para tareas cotidianas y también para trabajo”, elaborando desde tarjetas personales y fotos editadas hasta carteles, presentaciones o gráficos explicativos.

Ese uso extendido empujó el desarrollo de un nuevo modelo que asegura tener mayor precisión visual, mejor comprensión de instrucciones y capacidad para integrar texto dentro de las imágenes sin errores notorios.

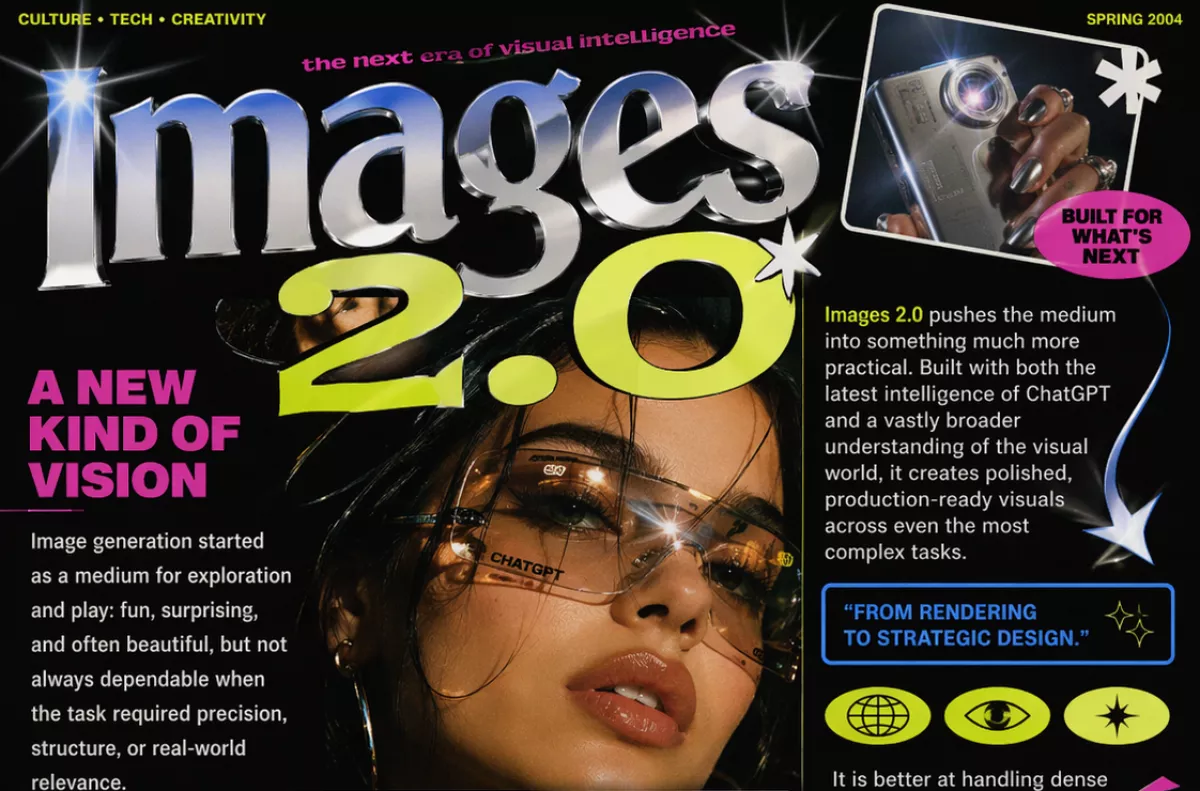

Imágenes 2.0 en ChatGPT

Uno de los cambios más relevantes que la empresa resaltó sobre su nueva herramienta está en la forma en que el modelo interpreta pedidos complejos. Según lo presentado, Images 2.0 logra “organizar elementos con mayor coherencia, respeta detalles específicos y genera composiciones más limpias”.

Esto permite crear desde interfaces y anuncios hasta diagramas o materiales educativos. En demostraciones, el sistema produjo infografías completas, páginas con continuidad visual y gráficos con texto legible, algo que versiones anteriores no resolvían con consistencia.

Otra mejora, según la empresa, es la interpretación en distintos idiomas, pues admitió que antes el rendimiento en inglés resultaba limitado, sobre todo en textos complejos. Ahora, la herramienta muestra mejoras en japonés, coreano, chino o hindi, con resultados que integran el lenguaje como parte del diseño.

El enfoque de la compañía es que Imágenes 2.0 funcione como asistente creativo que en lugar de generar una sola imagen aislada, puede producir varias piezas coherentes entre sí, mantener consistencia de personajes o estilos y adaptarse a distintos formatos.

Aunque el modelo mejora en calidad y alcance, las políticas sobre contenido se sostienen, con monitoreo activo y herramientas de reporte. Esto incluye restricciones en casos de manipulación política o usos considerados dañinos.