Este chip forma parte de un proyecto en el que la empresa ha trabajado desde 2023 y cuyo nombre es Meta Training and Inference Accelerator (MTIA), el cual busca reducir la dependencia ante los chips de Nvidia y, además, abordar la creciente cantidad de potencia de procesamiento necesaria para ejecutar sus productos de Meta AI.

“La arquitectura de este chip se centra fundamentalmente en proporcionar el equilibrio adecuado entre computación, ancho de banda de memoria y capacidad de memoria para servir modelos de clasificación y recomendación”, detalló la empresa en una publicación de blog.

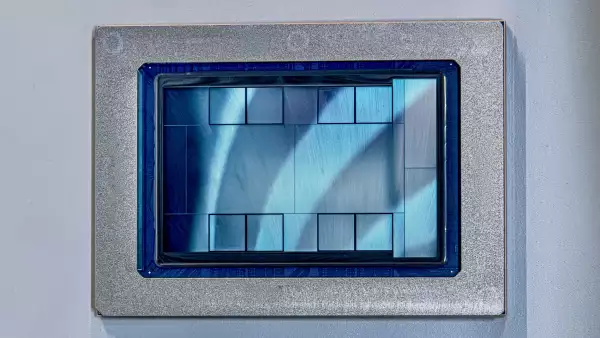

Yee Jiun Song, vicepresidente de ingeniería de Meta, comentó que el diseño de este componente fue un trabajo por completo de la empresa y serán fabricados bajo un nodo de 5 nanómetros por TSMC, el principal fabricante de chips a nivel mundial, entre cuyos clientes destacan Apple, Nvidia, Qualcomm y AMD, entre muchos otros.

Al igual que Google, en el caso de Meta los chips también tienen diferentes usos. El primero, de acuerdo con Song, ya se está implementando para el entrenamiento de modelos de IA pequeños, que se encargan de labores como clasificación y recomendación de contenidos.

Por otra parte, los tres chips restantes, señaló el especialista, están diseñados para tareas de inferencia avanzada para funciones de IA generativa, es decir, aquellas aplicaciones como creación de imágenes o videos basados en prompts.